摘要:3月19日至21日,英伟达CEO黄仁勋于GTC大会上公布了新一代芯片架构Blackwell,号称是英伟达“史上最成功的产品”。

3月18日至21日,英伟达于美国圣何塞召开GTC大会。作为AI与元宇宙时代的开发者大会,CTG每年都会云集来自世界各地的开发者、研究人员、IT 决策者、企业领袖,探讨如何利用 AI、加速计算、数据科学等技术力量塑造当今世界,因而被业界称之为“AI风向标”,也被一些网友戏称为“AI届春晚”。

而本届大会更是显得意义尤为重大,不仅因为这是GTC时隔五年首次重回线下举办,更是因为在英伟达CEO黄仁勋在主题演讲上公布了英伟达在加速计算、生成式AI及机器人等诸多领域的最新突破性成果。其中,尤其引人注意的便是英伟达的新一代芯片架构Blackwell,号称英伟达“史上最成功的产品”。

高算力低能耗,“新工业革命引擎”亮相

GPU(graphics processing unit)即图形处理器,又称显示芯片 ,是显卡的关键部件与连接计算机和显示终端的纽带,能够帮助用户通过个人电脑和一些移动设备(如平板电脑 、智能手机等)进行图像和图形相关运算工作。

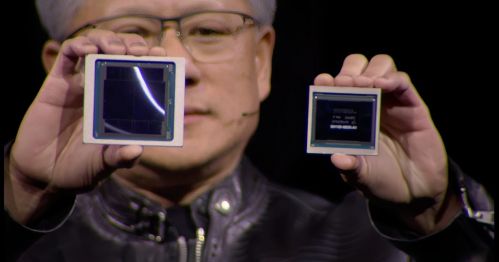

1999年8月,英伟达推出了全球首款GPU——GeForce 256,率先将显示芯片业带入GPU 时代,也自此奠定了其在GPU领域的先行者和领军人的地位。3月19日4时,在台下无数粉丝的期待下,黄仁勋正式官宣并展示了英伟达的新一代GPU——GB200,再度向世人宣告了英伟达在GPU领域难以撼动的领先地位。

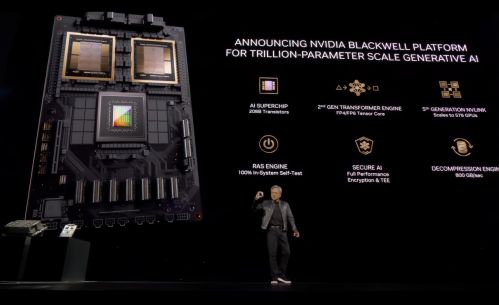

“通用计算已经失去动力,现在我们需要更大的模型、更大的 GPU,更需要将 GPU 堆叠在一起。”黄仁勋坦率地向所有与会者传达了他对GPU未来趋势的见解,而这一见解的产物就是新一代芯片架构Blackwell。Blackwell架构GPU以美国数理统计学家David Harold Blackwell的名字命名,其中包含2080亿个晶体管,是上一代芯片“Hopper”800亿个晶体管的2.6倍,可以支持多达10万亿个参数的AI模型。黄仁勋毫不吝惜地称之为英伟达“史上最成功的产品”。

基于Blackwell这一架构,黄仁勋还向世人介绍了最新的B200和GB200系列芯片。其中,B200芯片配备HBM3E内存,内存量高达192GB,在处理给聊天机器人提供答案等任务上,芯片的运行速度比上一代快30倍。GB200 Grace Blackwell超级芯片则由两颗B200芯片与Grace CPU组合而成,据黄仁勋介绍,该芯片的算力是H100的6倍,在对应处理多模态特定领域的算力表现更是可达30倍,而其成本和能耗却只是前代的25分之一。

“生成式AI是我们这个时代的决定性技术,Blackwell是推动这场新工业革命的引擎。”黄仁勋举例佐证道,使用Hopper GPU创建一个GPT-MoE-1.8T模型,需要8000个GPU、15兆瓦和90天,而使用Blackwell只需使用2000个GPU,且跑90天只要消耗四分之一的电力。

多家名企预计合作,英伟达稳步布局AI行业

“我们必须发明一些新技术,使之成为可能。”黄仁勋表示,英伟达近年来在人工智能芯片方面的探索从未停止,从不吝惜对芯片研发的成本投入。据他估计,Blackwell的研发花费了大约100亿美元,这一成本不仅仅是芯片本身,还包括设计数据中心和与其他公司数据中心集成的成本。而就Blackwell的售价,英伟达方面透露约在3万至4万美元之间,与其前身Hopper2.5万至4万美元的售价相似。

2022年底ChatGPT的横空问世,推动人工智能的热潮迅速席卷全球,这也为英伟达在内深耕人工智能计算的公司带来更加广阔的市场前景,Blackwell的前代产品Hopper很快成为全球诸多顶级人工智能公司和开发者用来训练人工智能模型的爆款。据英伟达财报,截至1月28日的2024财年第四财季,英伟达季度营收达到创纪录的221亿美元,较上年同期增长265%。

就新产品Blackwell的商业化方向,英伟达依旧准备向世界各地的人工智能公司进军。黄仁勋表示,英伟达预计与世界各地的所有OEM、区域云、国家主权AI、电信公司签约。而市场也早已给出了自己的答案,亚马逊、戴尔、谷歌、Meta、微软、OpenAI、特斯拉等知名企业都对Blackwell表现出了浓厚的兴趣,并已经计划使用Blackwell GPU。

智算升级大势所趋,国内产业道阻且长

现如今,人类迈向数智时代的已是不可阻挡的趋势,智能计算的三要素——算力、算法、数据,也正逐渐成为社会的信息基础设施的重要组成部分。AI算力更是数智时代最具活力和创新力的新型生产力,正在成为新质生产力的基建热点,以其为主要动力而延伸涌现的产业新赛道势必也将成为新质生产力的核心引擎。

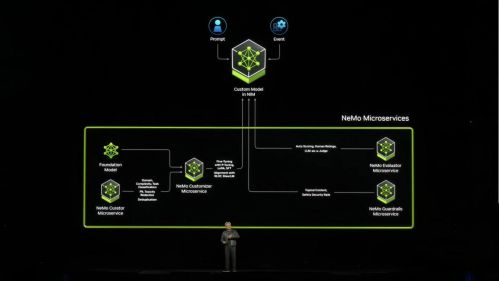

而在这时代发展的潮流之中,英伟达再度通过GTC大会向世界展示了它们灵敏的商业嗅觉和作为行业尖端的强大研发能力。事实上,本次大会中英伟达为公众带来的惊喜远不止于此,机器人领域通用大模型GROOT、6G研究云平台、全新的AI推理服务器NIM和“DRIVE Thor”车载计算平台,每一件产品的问世都足以推动AI技术迈向新的高峰。

信通院《中国综合算力指数(2023年)》显示,截至2023年6月底,中国算力规模达到1.97万亿亿次浮点运算,位居全球第二,其中智能算力规模占比达25%,规模同比增加60%。在我国算力规模特别是智能算力规模不断提升的背景下,英伟达此番轮出“王炸”客观上进一步拉大了中美两国芯片产业的差距,但也未必不会为国内相关产业带来“鲶鱼效应”般的正反馈。不过由于美国的芯片出口管制政策,国内相关产业若想弥合这种差距,加强彼此间的合作似乎成为必由之路。

正如中科院计算机所研究员张云泉认为,我们应该整合全国的AI芯片研发力量,成立统一的研发团队,通过精准选材,才能尽快研发出与英伟达高端训练GPU媲美的大型模型训练专用国产芯片、软件和系统。